Nous avons déjà écrit plusieurs articles sur le thème de l’intelligence artificielle sur notre blog. C’est ainsi que nous avons écrit, par exemple, comment GPT-3 fonctionne et comment les générateurs de texte peuvent améliorer les contenus. Mais une nouvelle innovation est apparue dans le monde des KI Wellen et c’est le texte du générateur d’images DALL-E 2. De quoi s’agit-il dans DALL-E 2 ? Wie funktioniert diese neue Technologie ? Et comment pourras-tu peut-être bientôt les utiliser pour toi ? Tu découvriras tout cela et bien plus encore dans cet article !

Qu'est-ce que DALL-E 2 ?

DALL-E 2 est le nouveau générateur texte-image révolutionnaire d’OpenAI. Il permet aux utilisateurs de créer des images sur la base d’invites de texte intégrées. Ce générateur utilise une intelligence artificielle appelée GPT-3, capable de comprendre la signification des mots saisis (natural language inputs) et de les restituer sous forme d’images. Grâce à l’utilisation de ces générateurs, les utilisateurs peuvent transformer leurs propres idées créatives en images légendaires.

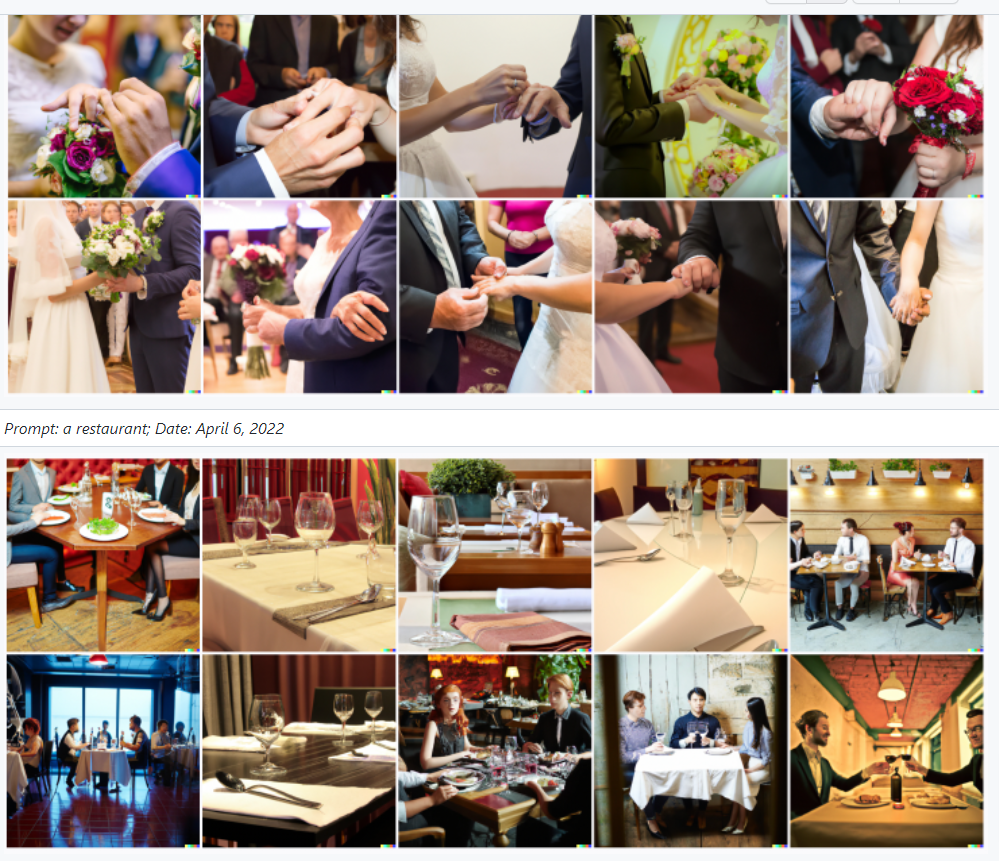

DALL-E 2 peut donc créer des images qui se basent sur des objets réalistes ou interpréter des entrées de texte qui n’existent pas dans la réalité. Si tu veux générer une scène réaliste, c’est un problème pour DALL-E 2 :

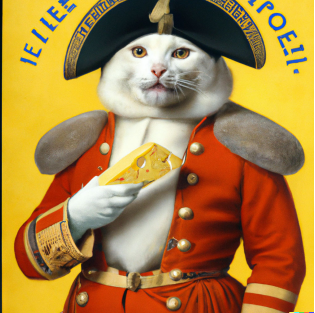

Veux-tu à la place créer une affiche de propagande de Napoléon Bonaparte sous la forme d’un chat tenant un morceau de fromage à la main ? Alors DALL-E 2 peut aussi t’aider ici :

La particularité de DALL-E 2 est qu’il s’agit d’un texte sur un générateur d’images et d’une technologie relativement nouvelle, qui n’a été mise au point qu’en avril 2022. DALL-E 2 s’appuie sur son prédécesseur DALL-E, qui a été publié en janvier 2021 et qui permet de générer des images photoréalistes à partir de textes. Il est donc intéressant d’en savoir plus sur la technologie utilisée dans DALL-E 2.

Alors DALL-E 2 peut aussi t'aider ici :

Le générateur de texte à image de DALL-E 2 utilise le traitement du langage naturel et l’intelligence artificielle pour que les informations provenant d’une invite textuelle soient interprétées et transposées dans un grand nombre d’images. Ce faisant, DALL-E peut contrôler 2 attributs différents dans une image comme dans le Photo Editing. Par exemple, le texte sur l’image peut modifier les objets du générateur ou les styles artistiques dans une image. Mais comment DALL-E 2 parvient-il à créer et à mettre en œuvre cette compréhension de l’image ? La réponse est franchement assez compliquée, mais je me suis quand même penchée sur le sujet pour ce billet de blog et je vais essayer de l’expliquer du mieux que je peux.

Tout d’abord, l’intelligence artificielle doit être entraînée. Grâce au deep learning, on lui apprend quelles connexions il doit établir pour générer le produit final. DALL-E 2 utilise pour cette tâche la technologie déjà existante de CLIP (Contrastive Language-Image Pre-training), qui a été développée par OpenAI. CLIP parvient à trouver des descriptions textuelles appropriées pour une image, en se basant sur des paires texte-image sur Internet. Le processus de DALL-E 2 se déroule en deux étapes :

Dans la partie supérieure de l’image, tu peux voir le programme de formation KI de CLIP. DALL-E 2 utilise le modèle CLIP pour créer des images de texte et créer un code latent homogène.

Dans la partie supérieure de l’image, la deuxième section est décrite, où l’invite textuelle est transformée en une nouvelle image. La deuxième étape consiste à prendre le code latent des paires texte-image et à l’envoyer à travers ce que l’on appelle un « Prior ». Ensuite, un générateur nommé Decoder sera utilisé pour créer de nouvelles variations de l’image, qui seront transmises par l’invite de texte.

La nouvelle variation d’image est donc créée en quelques étapes :

- La première chose à faire est de créer une invite de texte dans la boîte à texte. L’encodeur de texte est entraîné par le modèle CLIP à encoder des paires texte-image.

- Comme ensuite, un « Prior » est utilisé pour établir un lien entre l’intégration de texte CLIP (basée sur l’invite de texte) et l’intégration d’image CLIP, qui reflète les informations de l’invite de texte.

- Enfin, un décodeur est utilisé pour générer de nouvelles variations d’images qui représentent visuellement le texte prompt saisi.

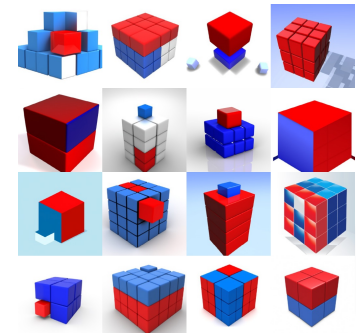

Il est ainsi possible de créer une multitude d’images différentes à l’aide de différentes entrées de texte :

La technologie utilisée dans DALL-E 2 est très complexe et si je ne suis pas un spécialiste de la recherche ou un expert dans le domaine du KI, je pense que cette explication est tout à fait pertinente. En fait, personne ne sait vraiment pourquoi de tels générateurs fonctionnent si bien ou ce que l’intelligence artificielle apprend en fin de compte. Il n’existe pas de théorie fondamentale pour le phénomène des apprentissages profonds, que tout le monde peut comprendre. Les réseaux utilisés par les IA sont trop vastes et trop compliqués pour que nous, les humains, puissions les comprendre entièrement avec nos connaissances actuelles. Tout ce que nous savons en ce moment, c’est que DALL-E 2, grâce au Deep Learning, ne peut pas seulement comprendre les objets individuels, mais aussi la relation entre ces objets.

Quoi de neuf dans DALL-E 2 ?

Comme nous l’avons déjà dit, l’image de DALL-E 2 est un générateur de texte pour la personne qui a tué DALL-E. Il est donc naturel de se demander ce qui est nouveau dans DALL-E 2 et ce que la technologie peut faire. La réponse est que DALL-E 2 propose de nombreuses nouvelles fonctions et améliorations :

- Le générateur d’images de texte de DALL-E 2 crée des images d’une qualité supérieure. DALL-E 2 se base ici sur un modèle à 3,5 millions de paramètres et utilise un autre modèle à 1,5 million de paramètres pour maximiser la résolution des images numériques. La réponse est que DALL-E 2 propose de nombreuses nouvelles fonctions et améliorations :

- DALL-E 2 génère des images réalistes. Les images, produites par DALL-E 2, sont plus complexes et comportent des arrière-plans complexes et des réflexions et des lumières réalistes. Les produits finaux de DALL-E 2 sont donc bien en avance sur les images de son prédécesseur, puisque DALL-E ne pouvait créer que des images de type catoons, souvent avec un arrière-plan sobre.

- Une nouvelle fonction révolutionnaire de DALL-E 2 est en outre une fonction appelée Inpainting. Avec cette fonction, le générateur de texte à l’image de DALL-E 2 peut effectuer différentes procédures d’édition de photos sur une image. Grâce à la saisie de texte, l’utilisateur peut déterminer les modifications et choisir une zone spécifique de l’image qu’il souhaite éditer. Avec DALL-E 2, on peut par exemple faire en sorte que les objets se trouvent dans des endroits différents de l’image, ce qui permet d’obtenir des images, des reflets et des textures grâce à l’intelligence kinesthésique.

- Le générateur de texte à l’image de DALL-E 2 offre un meilleur rapport entre les différentes scènes de jeu. DALL-E 2 permet de mieux comprendre les objets dans une image et leur relation avec les autres. Le programme sait que chaque pixel a une couleur différente et peut ainsi éliminer les objets de l’image. Par exemple, DALL-E 2 réalise que le sol dans l’image du bas reflète des réflexions et si un objet est ajouté, une réflexion de cet objet est automatiquement ajoutée.

- DALL-E 2 a un meilleur rapport avec les scènes mondiales. Le générateur d’images de texte comprend ce qui est important dans une image et contient des objets importants qui sont saisis dans la saisie de texte pour l’élaboration de nouvelles variations. Cela semble simple et évident, mais c’est un problème très complexe pour une machine qui ne produit que des pixels différents à la fin.

- Le générateur de texte à image DALL-E 2 permet de créer différentes variations d’une image dans différents styles. DALL-E 2 est capable de reproduire des images de différents styles. L’image générée peut représenter une version impressionniste de l’original :

- Ou bien DALL-E 2 reste très fidèle à l’original et n’apporte que de petites modifications au style, comme par exemple l’orientation de l’objet :

- Enfin, dans DALL-E 2, tu peux aussi ajouter une autre image à l’original et l’intelligence artificielle combine les images entre elles dans une nouvelle variation pour toi.

- Le générateur de texte pour DALL-E 2 est plus puissant et permet de mieux gérer les catégories d’images. Pendant le développement de DALL-E 2, il a été constaté que l’algorithme était sujet à des affectations erronées. Si le système est formé avec une image d’un animal, qui est une orange, alors l’intelligence naturelle est manipulée et le résultat est modifié. Ce problème a toutefois été corrigé dans DALL-E 2.

Les inconvénients possibles du générateur de texte à image DALL-E 2

Jusqu’ici, la technologie du générateur de texte à image DALL-E 2 semble très convaincante. Néanmoins, une telle technologie présente aussi des inconvénients et les utilisateurs doivent s’attendre à ce que tous les problèmes ne soient pas encore résolus :

- L’attribution d’attributs physiques n’est pas toujours correcte. DALL-E 2 ne parvient pas toujours à attribuer les bons attributs physiques aux objets d’une image. Si tu veux générer une image qui montre une boule de poil rouge sur une boule de poil bleu, tu peux faire en sorte que le générateur de texte de DALL-E 2 utilise les couleurs de la boule de poil :

- Un autre inconvénient majeur que le générateur de texte à image DALL-E 2 présente jusqu’à présent est qu’il ne peut pas générer de textes compréhensibles dans ses images. Si tu utilises un dessin avec le mot Deep Learning, tu obtiendras les résultats :

- Le générateur de texte à l’image de DALL-E 2 est encore plus délicat, car il permet de créer des détails à l’intérieur de scènes complexes. Si l’on raconte une image de Times Square à New York, on obtient une image très réussie, mais les employés de l’entreprise n’ont pas de détails précis :

- Un grand aspect de DALL-E 2 est que l’intelligence naturelle est formée avec des données provenant d’Internet. Comme nous le savons tous, Internet n’est pas toujours le meilleur endroit pour obtenir ses informations. Par conséquent, les images générées par DALL-E 2 sont soumises à un certain parti pris et diffusent parfois des stéréotypes. Si l’on veut générer des images de travailleurs du bâtiment, il faut aussi créer des images avec des travailleurs masculins. Si vous changez l’emploi d’ouvrier du bâtiment à hôtesse de l’air, seules les femmes seront affichées :

- Ce parti pris de l’intelligence artificielle a pour conséquence que le contenu peut être monotone, voire problématique. Les photos génériques peuvent être utilisées pour des thèmes tels que la nationalité, l’origine, la sexualité, le droit et la religion. Si l’on veut créer une image d’une fête de mariage, il faut créer une image hétéro-normative d’une fête de mariage chrétienne traditionnelle avec un père blanc et des vêtements blancs :

- Comme DALL-E 2 est encore une technologie relativement nouvelle, elle ne fonctionne pourl’instant qu’en anglais. Si tu ne maîtrises pas la langue anglaise, tu auras des difficultés à créer des invites de texte et à utiliser le programme en entier.

Quels sont les risques liés à DALL-E 2 ?

Malheureusement, il est souvent vrai que les technologies innovantes comme DALL-E 2 comportent aussi quelques dangers. L’éventuel échec de la technologie est l’un des plus grands dangers pour les développeurs, car DALL-E 2 n’est pas une technologie Open Source et ne peut être utilisée qu’avec l’accord des développeurs. Nous pouvons te dire que tu dois utiliser cette nouvelle technologie si rapidement que possible dans tes maisons, comme nous le voulons. Mais il semble que la liste d’attente pour le consommateur privé soit encore très longue :

Cette longue attente a toutefois une raison. Des technologies déjà existantes, comme les deep fakes, ont montré que les programmes permettant de manipuler des images pouvaient également être utilisés à mauvais escient. Des technologies déjà existantes, comme les deep fakes, ont montré que les programmes permettant de manipuler des images pouvaient également être utilisés à mauvais escient.

Le générateur de texte à l’image de DALL-E 2 a donc obtenu certaines garanties de sécurité, qui peuvent aider à éviter les erreurs de manipulation. Les filtres d’entrée peuvent empêcher les personnes de présenter certains types d’informations illicites (par exemple, des photos d’enfants à caractère sexuel ou suggestif, des photos de violence, des photos politiques explicites, etc.) Toutes les invites textuelles, que DALL-E 2 utilise, doivent rester dans des limites strictes. Afin de s’assurer que DALL-E 2 n’est pas un échec, et que les ingrédients sont bien utilisés, des échantillons de la banque de données KI ont été prélevés.

OpenAI a décidé que le générateur de texte à images de DALL-E 2 ne serait pas une version Open Source pour tous les utilisateurs, mais les développeurs sont conscients de leur responsabilité. C’est pourquoi OpenAI préfère agir avec prudence dans le cas de DALL-E 2, jusqu’à ce que tous les dangers aient été éliminés.

Nous avons acheté DALL-E 2 !

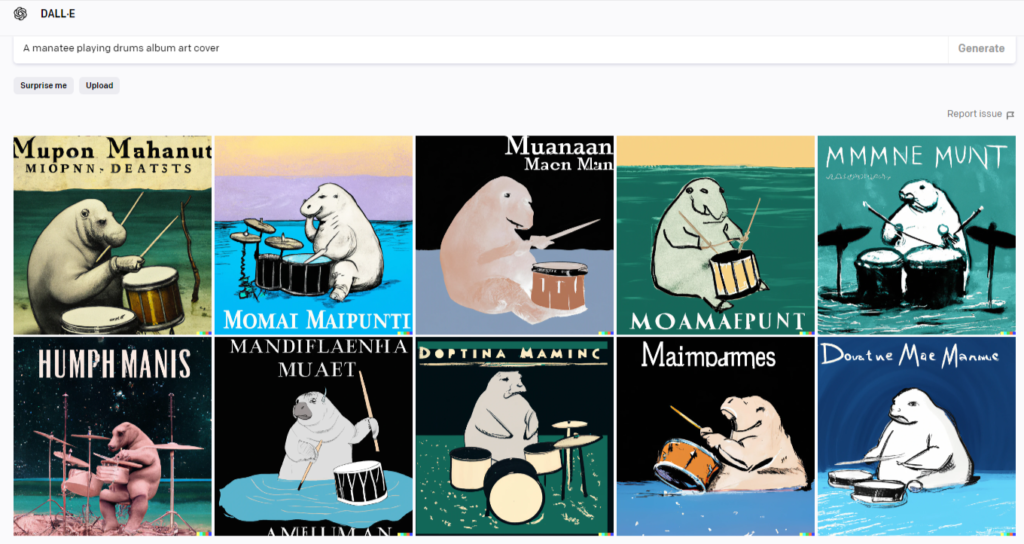

neuroflash est l’un des heureux utilisateurs qui ont reçu un accès d’essai à DALL-E 2 et qui peuvent ainsi générer gratuitement jusqu’à cinquante Text Prompts par jour. Bien sûr, je me suis lancé directement pour tester cette nouvelle technologie et j’en suis vraiment ravi ! La diversité des images que l’on peut générer avec DALL-E 2 est étonnante. Ainsi, l’homme peut utiliser plusieurs styles et aussi le contexte pour les images générées. Si tu veux créer une pochette d’album, tu dois choisir dans l’invite seulement « album cover art » :

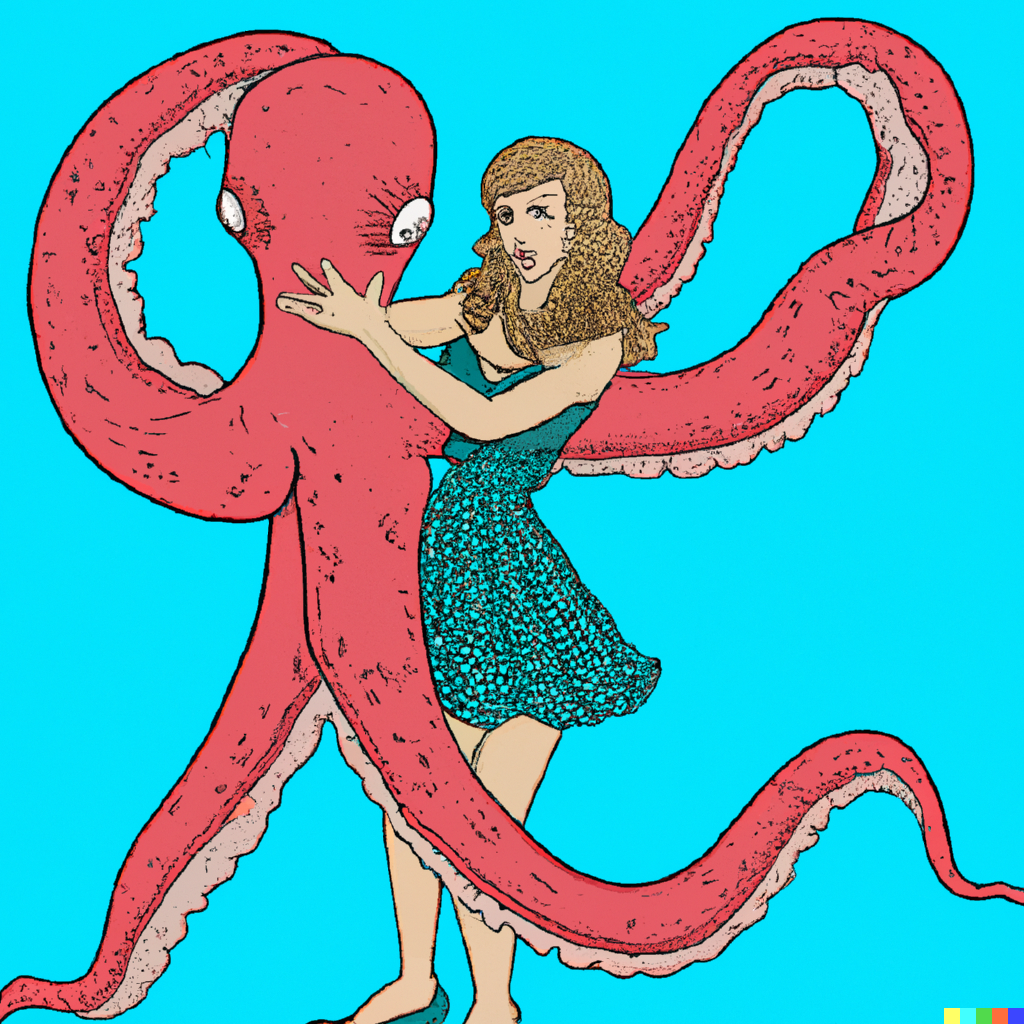

Une grande question qui m’a préoccupé est de savoir s’il est possible de créer des images de personnes connues. Il n’est pas possible de créer des images réalistes de personnes célèbres (en raison du risque de fausses images). DALL-E 2 peut cependant générer des images avec des hommes, pour que les personnages de la personne la plus importante puissent s’épanouir, même si une certaine ambiguïté est présente. Il n’est pas possible de créer des images réalistes de personnes célèbres (en raison du risque de fausses images).

Ou voici une photo de Taylor Swift dansant avec une pieuvre :

L’homme peut aussi travailler sur les images générées dans la machine à coudre, en remplissant une partie de l’image et en écrivant la nouvelle image. L’homme peut aussi créer des variations dans les images génériques, afin d’obtenir davantage d’options. Cependant, il est vrai que des détails peuvent être perdus. Dans cette variation de l’image de Taylor Swift, l’orphelinat a été déformé par un morceau de tissu :

Une bonne surprise a été de constater que les textes possibles dans les images générées sont finalement plus précis et sans erreur que prévu. Si l’on utilise des mots simples, le KI peut générer ces mots de manière correcte :

Il est important de noter que les invites de texte sont détaillées et exactes. Si tu veux générer un combat de boxe entre un pingouin et un robot et que tu reçois l’invite « combat de boxe », tu peux obtenir ce résultat :

Si tu n’as pas encore trouvé le terme « match de boxe », tu peux alors créer l’image que tu veux :

Tout bien considéré, on peut dire que DALL-E 2 est une nouvelle technologie étonnante qui ne pose aucune limite à la créativité humaine. Je suis sûr que dès que DALL-E 2 sera publié, de nombreuses personnes pourront utiliser la technologie de différentes manières.

Pourquoi utiliser DALL-E 2 ?

Bien sûr, DALL-E 2 n’apporte pas que des dangers, mais aussi de nouvelles possibilités fantastiques ! Le générateur de texte à l’image de DALL-E 2 est une nouvelle technologie très intéressante, qui peut être utilisée de différentes manières.

Nous espérons que DALL-E 2 permettra aux gens de s'exprimer de manière créative. DALL-E 2 nous aide aussi à comprendre comment les systèmes d'IA avancés voient et comprennent notre monde, ce qui est essentiel pour notre mission de création d'IA qui profite à l'humanité.

Open-AI

Avec DALL-E 2, tu peux créer efficacement des images créatives et originales. Il ne faut pas avoir de compétences en retouche photo ni un sens aigu de l’art. De même, il n’est plus nécessaire de connaître les logiciels de retouche photo (par ex. Photoshop) pour traiter une image.

C’est pourquoi le générateur de texte à l’image de DALL-E 2 n’est pas seulement un outil qualitatif de qualité, mais aussi très rapide. En seulement wenigen Minuten lassen sich neue Bilder generieren, für deren Erstellung ein Mensch eventuell Stunden gebraucht hätte. Ta créativité n’a pas de limites à cause de la diversité des options. Au contraire ! DALL-E 2 va défier et élargir la créativité des gens.

Enfin, le générateur de texte à image DALL-E 2 est un excellent exemple de la manière dont l’intelligence artificielle ne cesse d’évoluer. Les images générées par DALL-E 2 pourront nous montrer à l’avenir si le système comprend réellement la pensée humaine ou s’il ne fait qu’imiter ce que nous lui enseignons.

Conclusion:Nous sommes très inquiets de savoir comment le générateur de texte à images de DALL-E 2 a été conçu et nous ne pouvons pas nous empêcher de travailler avec DALL-E 2 ! Si tu ne veux pas rester aussi longtemps, tu pourras alors profiter des avantages du AI, qui sont déjà sur le marché. Tu peux donc, avec le générateur de texte neuroflash, générer gratuitement jusqu’à 2 000 mots à partir d’une intelligence naturelle et les décliner en plus de 50 textes différents !

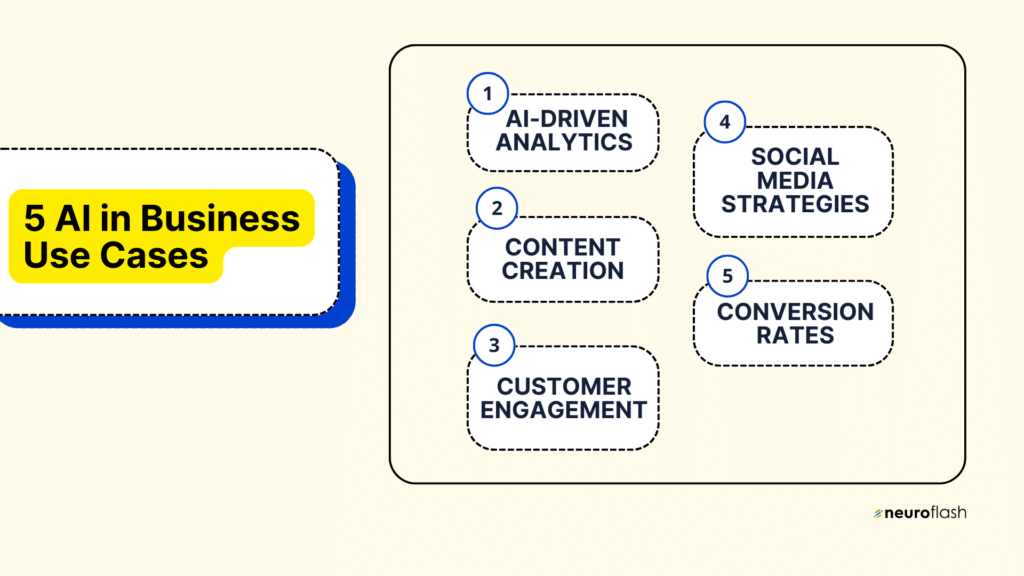

Générer des images d'IA uniques avec neuroflash

Avec la capacité de générer des images à partir de textes, le potentiel de l’intelligence artificielle en tant que ressource devient évident. C’est un grand progrès réalisé grâce à la technologie moderne. C’est pourquoi neuroflash associe désormais le générateur de texte n°1 en langue allemande à une nouvelle fonctionnalité, la génération de texte en image. Ainsi, neuroflash est la première entreprise de la région DACH à offrir à ses clients la possibilité d’essayer gratuitement la génération d’images par l’IA.

Comment gagner de l’argent avec les images générées par l’IA de neuroflash et les utiliser pour votre entreprise ?

- Livres à faible contenu

- Couvertures de livres, chansons, bandes dessinées, e-books, …

- Illustrations pour des histoires à dormir debout, des livres, des bandes dessinées…

- Images d’impression à la demande ou cartes postales

- Images de stock faciles à utiliser pour les blogs (par exemple, les blogs sur l’alimentation)

- NFTs

- Présentations et diaporamas

- Images pour les médias sociaux, les bulletins d’information

- Inspirations pour la conception de pages d’accueil et de produits.

Astuce: Combinez le neuroflash avec Photoshop ou d’autres programmes :

- Utilisez Photoshop et agrandissez nos images de 72 dpi à 300 dpi avec Preserve Details 2.0.

- Dans la dernière version de Photoshop (Beta), il existe une fonction « Récupération de photos » sous « Filtres neuronaux » qui améliore généralement l’apparence des yeux et d’autres traits faciaux bizarres.

- Effectuez ensuite quelques corrections de base des courbes et des couleurs et éclaircissez un peu les yeux.