Seit der Veröffentlichung von OpenAI GPT-3 im Juni 2020 ist klar, dass sich die NLP-Welt (natural language processing) gerade in einem rasanten Wandel befindet. Die Erwartungen an den vierten Prototypen (GPT-4) sind dementsprechend hoch und es gibt viele Mutmaßungen und Prognosen über die möglichen Features und Verbesserungen. In diesem Blogbeitrag werden die aktuellsten Informationen zu den GPT-4 Parameters zusammengefasst.

GPT-4 Parameters: Die Fakten nach dem Release

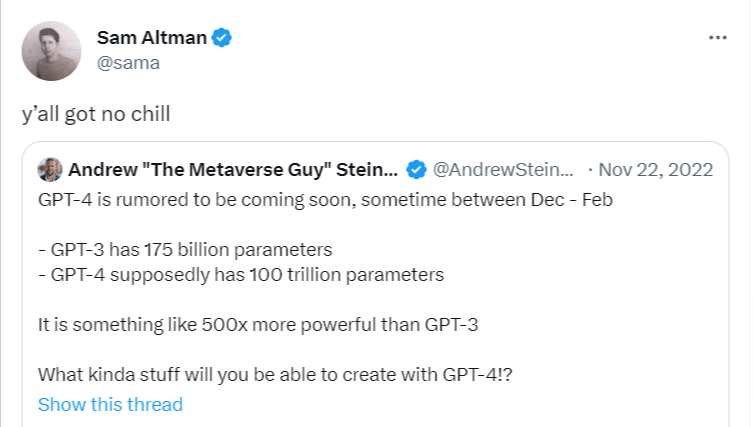

Seit der Veröffentlichung von GPT-4 wurden noch keine Angaben zu den in GPT-4 verwendeten Parametern gemacht. Allerdings gibt es Spekulationen, dass OpenAI rund 100 Billionen Parameter für GPT-4 verwendet hat. Dies wurde jedoch von OpenAI-CEO Sam Altman dementiert. Aber da GPT-3 175 Milliarden Parameter hat, können wir eine höhere Zahl für das neue Sprachmodell GPT-4 erwarten.

Überblick über GPT-4 Parameters: Gerüchte und Prognosen

GPT-4 Parameters Gerüchte und Prognosen - Was ist zu beachten?

Was würden die GPT-4 Parameters Prognosen bedeuten?

- Wenn es tatsächlich eine Parameterzahl von 100 Billionen hat, ist es wahrscheinlich, dass es ein spärliches Modell sein wird. Das würde es viel schneller machen und weniger Speicherplatz benötigen, da die Tensoren viel kleiner wären. Dies würde auch bei der Skalierung helfen, da ein Sprung von 175 Milliarden Parametern auf 100 Billionen Parameter ohne die Verwendung von spärlichen Netzwerken nicht gut skalierbar wäre.

- Eine weitere Einschränkung, die es zu berücksichtigen gilt, ist der Speicherbedarf für GPT-4. GPT-3 benötigt derzeit 700 Gigabyte V-RAM, und wenn GPT-4 die tausendfache Anzahl von Parametern hat, würde es 700 Terabyte V-RAM benötigen. Dies wäre eine erhebliche Investition für OpenAI und würde wahrscheinlich die Verwendung von spärlichen Netzwerken erfordern, um den benötigten Speicher zu reduzieren.

- Es ist auch möglich, dass GPT-4 nicht viel größer ist als GPT-3 und im Bereich von 1 Billion oder 10 Billionen Parametern liegt. In diesem Fall würde es immer noch von der Verwendung spärlicher Netze profitieren. Dies könnte auch erklären, warum die Entwicklung des GPT-4 zwei Jahre oder länger gedauert hat, da es einen Wechsel von dichten zu spärlichen Netzen und die Entwicklung neuer Trainingsalgorithmen erfordert haben könnte.

- Die Verwendung von spärlichen Netzen könnte auch zu einer Änderung der Architektur führen, ähnlich wie bei Google Switch, das nur das aktiviert, was benötigt wird. Dies könnte bedeuten, dass das GPT-4 eine neuromorphe Architektur hat, bei der nur bestimmte Teile des Netzwerks bei Bedarf aktiviert werden. Dies ist vergleichbar mit der Funktionsweise des menschlichen Gehirns, bei dem nur bestimmte Regionen aufleuchten, wenn bestimmte Aufgaben ausgeführt werden.

GPT-4 vs GPT-3

Möchtest du einen genauen Vergleich zwischen GPT-4 vs. GPT-3? Dann klicke hier!

neuroflash als Beispiel für GPT-4 Anwendungen

neuroflash kombiniert sowohl GPT-3 als auch GPT-4 in vielen Anwendungen wie Inhaltserstellung, KI-Chat, Beantwortung von Fragen und vieles mehr. Dabei ermöglicht neuroflash seinen Nutzern, auf Basis eines kurzen Briefings verschiedene Texte und Dokumente erstellen zu lassen. Mit über 100 verschiedenen Textarten kann die neuroflash KI Texte für jeden Zweck generieren. Wenn du z.B. eine Produktbeschreibung mit neuroflash erstellen willst, musst du der KI nur kurz dein Produkt beschreiben und die magische Feder erledigt den Rest:

Auch bei kreativere Aufgaben kann neuroflash behilflich sein. Möchtest du zum Beispiel eine Geschichte schreiben, so ist auch dies möglich:

Schließlich kannst du neuroflash auch als ChatGPT Alternative nutzen und direkt mit unserer KI kommunizieren. Wir zeigen dir in einem kurzen Video, wie es geht:

Mit neuroflash lassen sich zudem nicht nur Texte generieren. Weitere Funktionen, wie eine SEO Analyse für geschriebene Texte und ein KI Bildgenerator bieten zusätzlichen Mehrwert.

Möchtest auch du von der geballten GPT-4 Kraft plus zusätzlichen Funktionen profitieren? Dann teste neuroflash doch selbst und erstelle dir ein kostenloses Konto!