Zusammenfassung

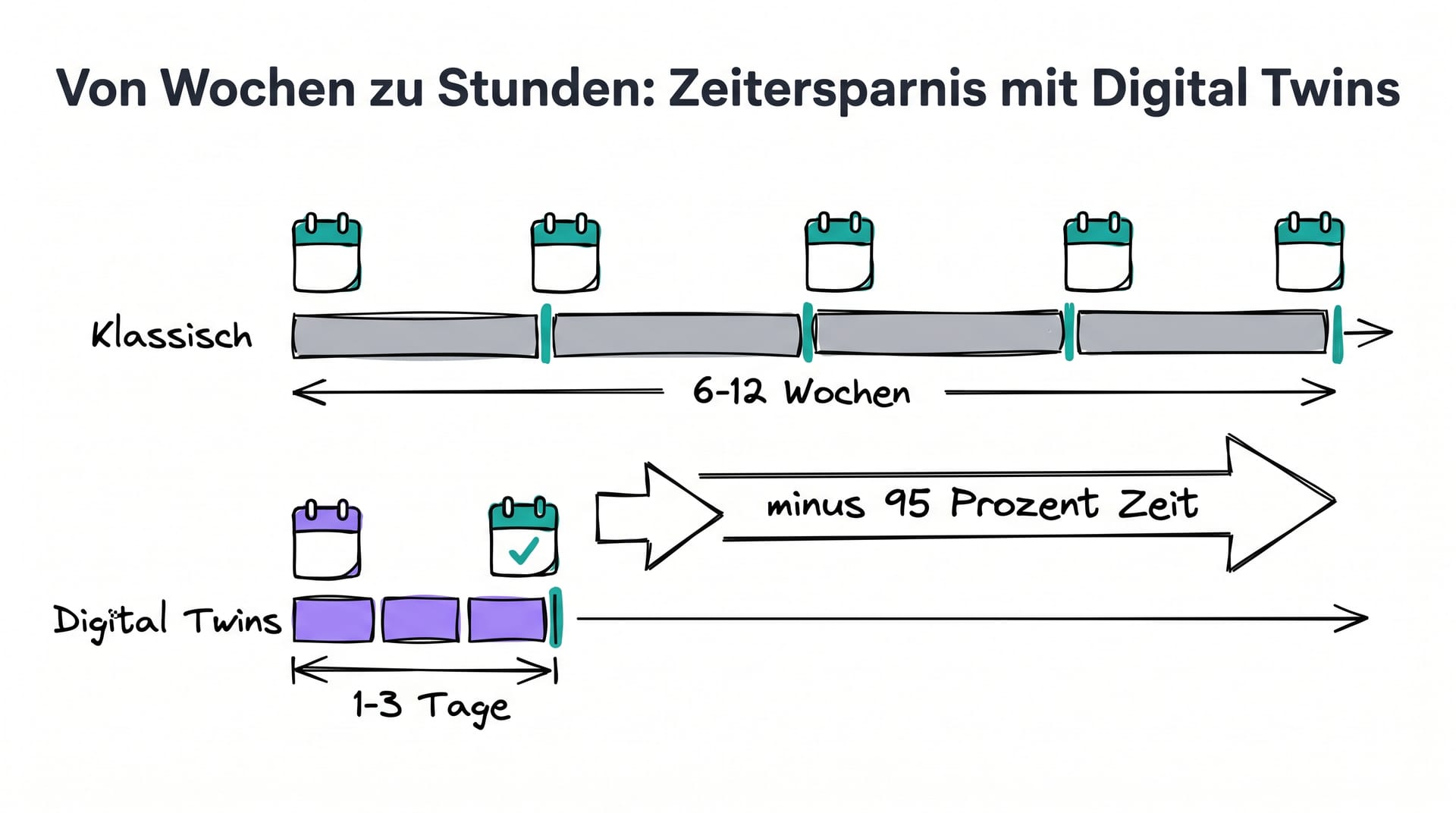

- Klassische Marktforschungsstudien dauern in der Regel 6 bis 12 Wochen vom Briefing bis zum Reporting, Digital Twins liefern vergleichbare Ergebnisse in 1 bis 3 Tagen.

- Die größte Zeitersparnis entsteht in den Phasen Recruiting (von 7 bis 14 Tagen auf null) und Feldzeit (von 7 bis 21 Tagen auf wenige Stunden).

- Insights-Teams, die auf AI-basierte Methoden umstellen, erhöhen ihre Studienkapazität typischerweise um den Faktor 3 bis 5 pro Quartal.

- Zeitgewinn entsteht nicht automatisch, schlechte Briefings, fehlende Standardisierung und Stakeholder-Bottlenecks können die Vorteile zunichte machen.

- Hybrid-Ansätze, die Digital Twins für die Iteration und klassische Methoden für die Validierung nutzen, kombinieren Geschwindigkeit mit methodischer Tiefe.

- Time-to-Insight wird zum strategischen Wettbewerbsvorteil, weil schnellere Studien direkt in schnellere Time-to-Market und höhere Kampagnen-Performance münden.

Einleitung

Time-to-Insight ist im Jahr 2026 der entscheidende Wettbewerbsvorteil im Marketing geworden. Während Produktteams in zweiwöchigen Sprints arbeiten und Kampagnen-Manager in Tagen denken, hängt die klassische Marktforschung weiterhin an Durchlaufzeiten von zwei bis drei Monaten. Dieser Bruch zwischen agiler Organisation und langsamer Insights-Funktion macht Marktforschung in vielen Unternehmen zum Bottleneck. Entscheidungen werden ohne Daten getroffen, weil das Warten zu teuer wäre. [1]

Digital Twins, also AI-basierte Simulationen menschlicher Befragungsteilnehmer, ändern diese Gleichung fundamental. Statt Wochen für Recruiting und Feldzeit zu investieren, läuft eine Befragung in Minuten oder Stunden. Der vorliegende Artikel zerlegt den klassischen Studienprozess in seine Phasen, zeigt phasenweise wo der Zeitgewinn entsteht, und beleuchtet, wie Insights-Teams die gewonnene Zeit konkret in Geschäftswert ummünzen. Wer den finanziellen Hintergrund dazu sucht, findet im Pillar-Artikel zu ROI AI-Marktforschung die übergeordnete Perspektive.

Wie lange dauern klassische Studien wirklich?

Die wahrgenommene Dauer einer Marktforschungsstudie und ihre tatsächliche Durchlaufzeit klaffen oft auseinander. Wer einen Concept-Test bestellt, denkt an die Feldzeit von zwei Wochen, vergisst aber Briefing-Schleifen, Sample-Aufbau und Reporting. Eine realistische Phasen-Aufschlüsselung sieht so aus:

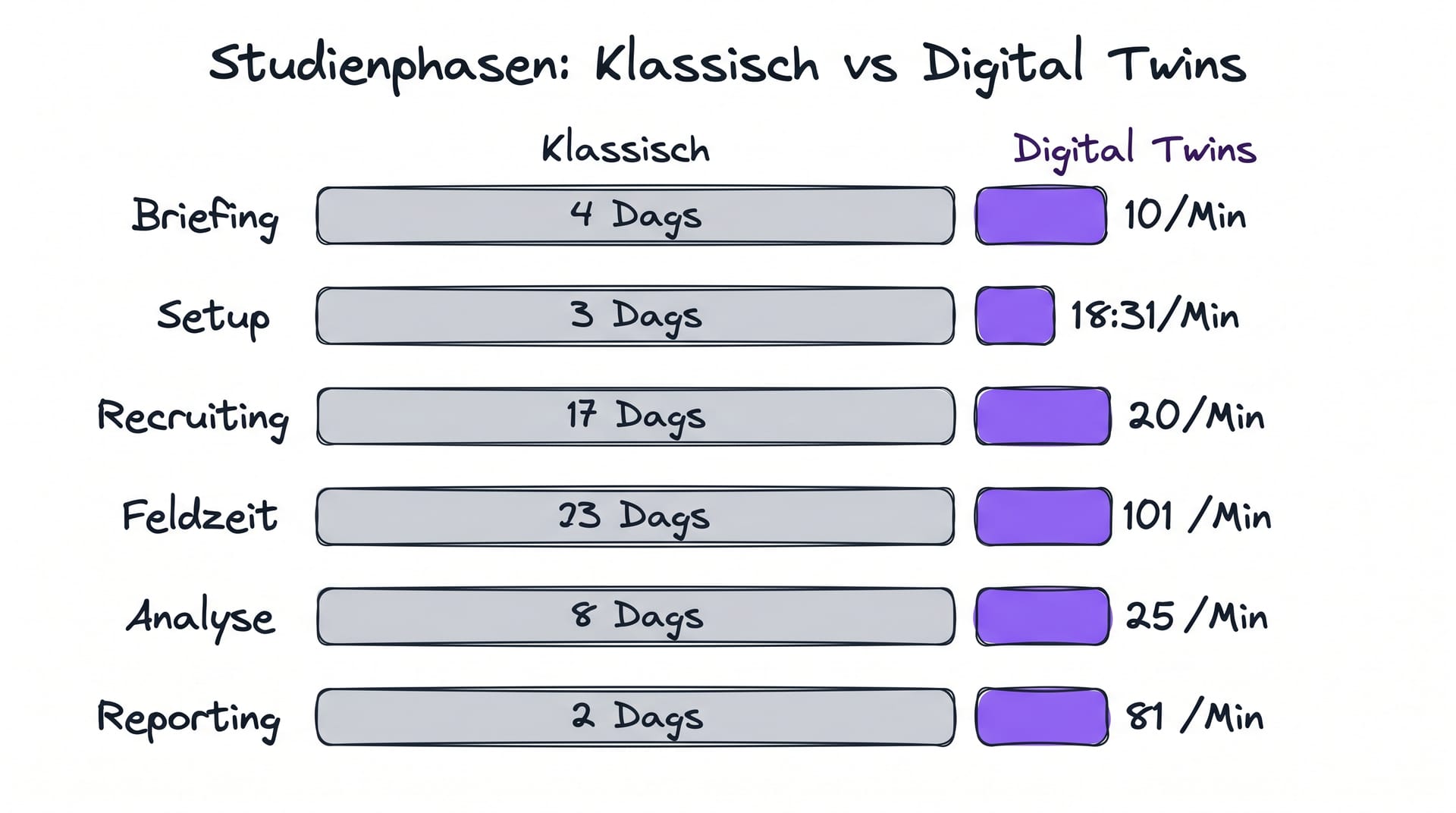

Briefing (2 bis 3 Tage): Abstimmung zwischen Auftraggeber und Institut, Finalisierung der Forschungsfragen, Festlegung der Zielgruppe. Mehrere Iterationen sind die Regel.

Setup und Programmierung (3 bis 5 Tage): Programmierung des Fragebogens, Quotenmodell, Übersetzung bei mehrsprachigen Studien, Pretest und Korrekturen.

Recruiting und Sample (7 bis 14 Tage): Aufbau des Panels, Filterung auf Zielgruppen-Kriterien, Incentivierung. Bei Nischen-Zielgruppen oder B2B-Studien dauert diese Phase deutlich länger. [2]

Feldzeit (7 bis 21 Tage): Eigentliche Befragung, Reminder-Wellen, Quotenmanagement, Datenkontrolle.

Analyse (5 bis 10 Tage): Datenaufbereitung, Bivariate und multivariate Analysen, Significance Testing, qualitative Verdichtung von Open-Ends.

Reporting (3 bis 5 Tage): Erstellung des Charts-Decks, Storyline, Handlungsempfehlungen, mehrere Review-Runden mit dem Auftraggeber.

In Summe ergeben sich realistisch 6 bis 12 Wochen vom ersten Briefing bis zum finalen Report. Bei internationalen oder methodisch komplexen Studien sind drei bis vier Monate keine Seltenheit. [3]

Vergleichstabelle: Klassisch vs Digital Twins

| Phase | Klassisch | Digital Twins | Zeitgewinn |

|---|---|---|---|

| Briefing | 2 bis 3 Tage | 1 bis 2 Stunden | etwa 95 Prozent |

| Setup und Programmierung | 3 bis 5 Tage | 30 Minuten | über 99 Prozent |

| Recruiting und Sample | 7 bis 14 Tage | sofort | 100 Prozent |

| Feldzeit | 7 bis 21 Tage | Minuten bis Stunden | über 99 Prozent |

| Analyse | 5 bis 10 Tage | sofort und automatisiert | 100 Prozent |

| Reporting | 3 bis 5 Tage | Stunden | etwa 90 Prozent |

| Total | 6 bis 12 Wochen | 1 bis 3 Tage | etwa 95 Prozent |

Die Tabelle zeigt, dass der Zeitgewinn nicht in einer einzelnen Phase entsteht, sondern in nahezu jedem Schritt. Das ist wichtig zu verstehen, weil viele Stakeholder beim Stichwort AI-Marktforschung nur an die Befragung selbst denken. Tatsächlich kommen die größten Zeitblöcke aus Recruiting und Analyse, die bei Digital Twins komplett wegfallen oder automatisiert ablaufen.

Wo entsteht der Zeitgewinn konkret?

Vier strukturelle Hebel erklären, warum AI-basierte Befragungen so dramatisch schneller sind:

Kein Recruiting nötig. Digital Twins sind als trainierte Modelle bereits vorhanden, sie müssen nicht für jede Studie neu rekrutiert werden. Bei Nischen-Zielgruppen wie B2B-Entscheidern oder Fachärzten ist das der größte Hebel, weil Recruiting hier oft mehrere Wochen kostet. [4]

Parallele statt sequentielle Befragung. Während ein klassisches Panel sequentiell Antworten sammelt, können tausende Digital Twins parallel befragt werden. Die Skalierung ist nahezu linear, eine Befragung mit 200 oder 2.000 Twins unterscheidet sich kaum in der Laufzeit.

Automatisierte Auswertung. Die Antworten liegen sofort strukturiert vor, Codierung von offenen Fragen erfolgt durch dieselben Modelle, die die Befragung durchgeführt haben. Statistische Tests, Cross-Tabs und Top-Box-Analysen laufen on-demand. Mehr dazu im Beitrag Marktforschung automatisieren.

Sofortige Iteration. Wenn das erste Ergebnis Fragen aufwirft, lässt sich die Studie binnen Minuten anpassen und neu fahren. In klassischer Marktforschung bedeutet jede Iteration eine zusätzliche Welle mit allen Phasen.

4 Praxisbeispiele für die Geschwindigkeit

Konkrete Anwendungsfälle illustrieren, was diese Zeitersparnis im Arbeitsalltag bedeutet:

Concept-Test in 4 Stunden. Ein FMCG-Hersteller testet drei Verpackungsvarianten gegen ein Kontroll-Design. Briefing am Morgen, Setup über Mittag, Befragung am frühen Nachmittag, Report am Abend. Das Brand-Team kann am nächsten Tag mit der Agentur weiterarbeiten. Weitere Beispiele in den FMCG-Fallstudien zu AI-Marktforschung.

Claim-Test über Nacht. Eine Versicherung testet acht Werbe-Claims für eine Kampagne, die in der Folgewoche on air geht. Briefing um 17 Uhr, Ergebnisse am nächsten Morgen um 9 Uhr. Die Top-Performer gehen in die finale Produktion, schwache Claims werden ausgeschlossen.

Brief-Validierung im Meeting. Ein Insights-Manager schaltet während eines Strategie-Workshops eine kurze Befragung zu Zielgruppen-Hypothesen live, die Ergebnisse fließen direkt in die Diskussion ein. Was früher als Hausaufgabe für die nächste Woche endete, wird zum integralen Teil des Meetings.

Iteration in einer Woche. Ein Pharma-Unternehmen testet eine Patienten-Kommunikation, identifiziert in Welle 1 Verständnisprobleme, überarbeitet die Botschaften, fährt Welle 2, validiert die Verbesserung. Drei Iterationen in fünf Werktagen, klassisch wäre dafür ein Quartal nötig gewesen.

Was bedeutet Time-to-Insight für den Business Case?

Schnellere Studien sind kein Selbstzweck, sie verändern die Art, wie Marketing und Produktentwicklung mit Daten arbeiten. Drei konkrete Effekte lassen sich messen:

Mehr Studien pro Quartal. Ein typisches Insights-Team mit zwei Researchern bearbeitet klassisch sechs bis acht Studien pro Quartal. Mit Digital Twins steigt diese Zahl auf 25 bis 35, weil die Engpassressource nicht mehr Feldzeit, sondern Briefing- und Stakeholder-Kapazität ist. [5]

Schnellere Time-to-Market. Wenn jede Validierungsschleife drei Wochen kostet, werden Schleifen zur Mangelware. Wenn sie einen Tag kostet, werden sie zum Standard. Produkte launchen mit besser validierten Konzepten, Kampagnen mit getesteten Claims, Verpackungen mit optimierten Varianten.

Weniger blockierte Kampagnen. Marketing-Teams berichten, dass Kampagnen-Launches sich häufig verzögerten, weil Insights-Reports nicht rechtzeitig fertig wurden. Mit AI-basierter Marktforschung verschiebt sich der Engpass weg von der Forschung. Wie man dieses Argument intern verkauft, zeigt der Artikel Stakeholder von AI-Marktforschung überzeugen.

Tabelle: Was ein Insights-Team mit der gewonnenen Zeit anstellt

| Aktivität | Vorher (klassisch) | Nachher (mit Digital Twins) |

|---|---|---|

| Studien pro Jahr | 8 | 30 plus |

| Iterationen pro Konzept | 1 bis 2 | 4 bis 6 |

| Anteil ad-hoc Anfragen | 10 Prozent | 40 Prozent |

| Antwortzeit auf Stakeholder-Frage | 4 bis 6 Wochen | 1 bis 2 Tage |

| Anteil strategischer Beratung | 20 Prozent | 50 Prozent |

| Bearbeitete Geschäftsfragen pro Researcher | 4 bis 6 | 15 bis 20 |

Bemerkenswert ist die Verschiebung der Tätigkeitsstruktur. Wenn die operative Arbeit weniger Zeit kostet, wird Insights zum strategischen Sparringspartner statt zum reinen Datenlieferanten. Diese Rollenveränderung ist oft der größere Effekt als die reine Zeitersparnis.

Wo Digital Twins NICHT schneller sind

Bei aller Geschwindigkeit gibt es Bereiche, in denen Digital Twins nicht oder nur eingeschränkt schneller liefern:

Validierungs-Phasen am Anfang neuer Use Cases. Wenn ein Twin-Modell für eine spezifische Zielgruppe noch nicht validiert ist, kostet die initiale Kalibrierung Zeit. Diese Investition zahlt sich allerdings ab der zweiten Studie aus. Mehr zur Methodik unter Repräsentativität bei AI-generierten Marktforschungspanels.

Sensorische Tests. Geschmack, Haptik, Geruch und ähnliche physische Erfahrungen lassen sich nicht digital simulieren. Hier bleibt die klassische Methode unverzichtbar. [6]

Tiefen-qualitative Forschung. Ethnographische Beobachtung, Tiefeninterviews mit echten Lebenswelten, kulturelle Einbettung sind Bereiche, in denen menschliche Forscher und Probanden weiterhin überlegen sind.

Hybrid-Ansätze kombinieren beide Welten. Digital Twins liefern schnelle Iteration und breite Screening-Tests, klassische Methoden validieren die finalen Konzepte. So entsteht ein Trichter, der Geschwindigkeit und Tiefe vereint, ohne dass eine Methode die andere ersetzt. Eine Übersicht entsprechender Werkzeuge findet sich unter Tools für AI-basiertes Pre-Testing.

5 Fehler, die den Zeitgewinn zunichte machen

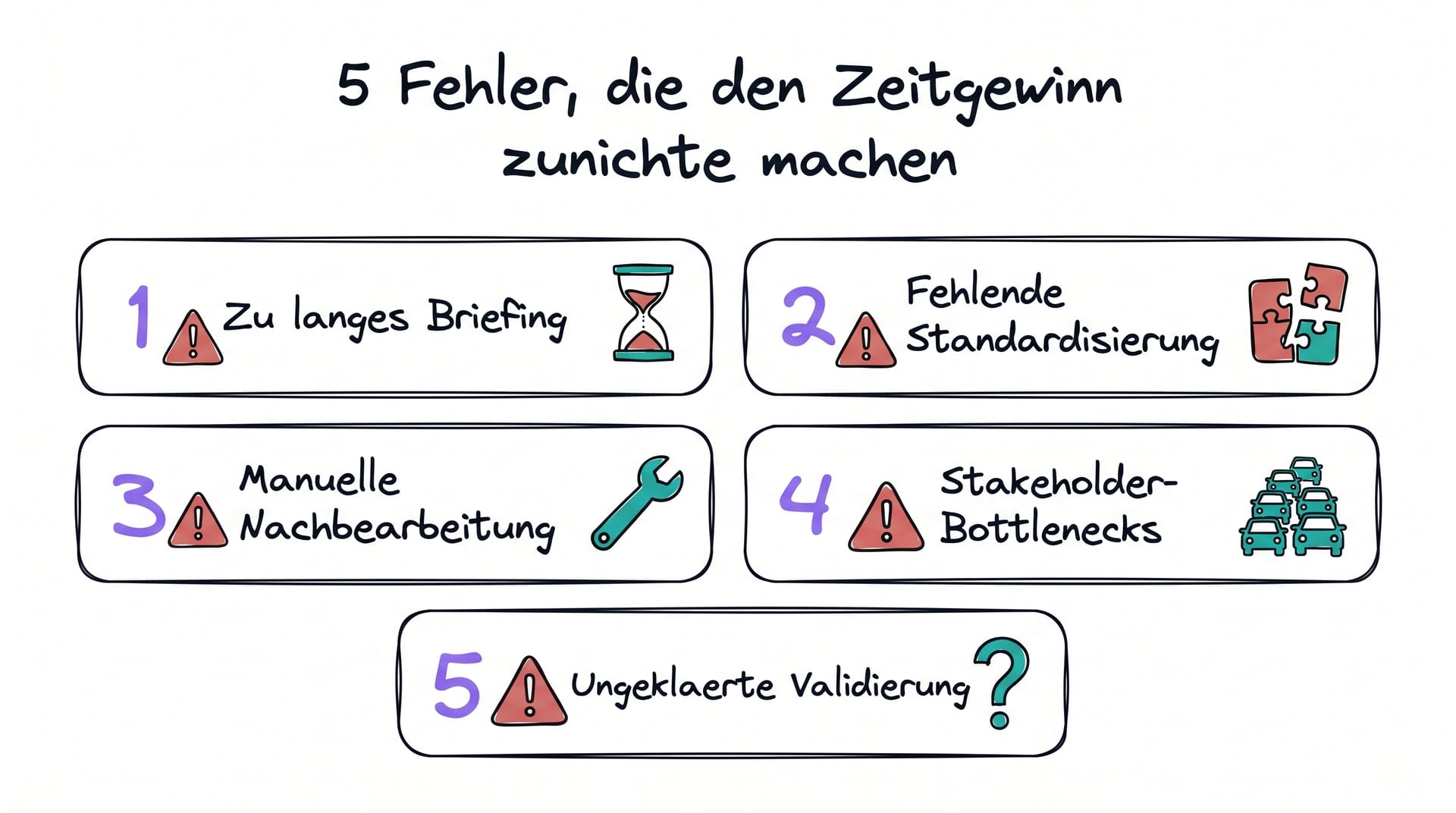

Auch mit der schnellsten Methode ist eine Studie nur so schnell wie ihre langsamste Komponente. Diese fünf Fehler beobachten wir am häufigsten:

Zu langes Briefing. Wenn das interne Stakeholder-Management drei Wochen dauert, ist es egal ob die Befragung vier Stunden oder zwei Wochen läuft. Standardisierte Brief-Templates und feste Slot-Zeiten mit Stakeholdern lösen das Problem.

Fehlende Standardisierung. Jede Studie wird neu erfunden, statt auf wiederverwendbare Module zurückzugreifen. Ein Concept-Test sollte in einer Stunde aufgesetzt sein, nicht in einem Tag.

Manuelle Nachbearbeitung. Wenn Researcher die automatisch generierten Reports trotzdem komplett neu schreiben, geht der Geschwindigkeitsvorteil verloren. Templates und klare Reporting-Standards helfen.

Stakeholder-Bottlenecks. Reports liegen vor, aber Entscheidungen warten auf den nächsten Jour Fixe in zwei Wochen. Die Insights-Funktion muss ihre eigenen Prozesse mit der neuen Geschwindigkeit synchronisieren.

Ungeklärte Validierung. Ohne klares Bild, wann Digital-Twin-Ergebnisse ausreichen und wann eine klassische Validierung nötig ist, entstehen unsichere Entscheidungen oder doppelte Studien. Eine dokumentierte Methoden-Policy beschleunigt die Entscheidungsfindung.

neuroflash für schnelle Insights im DACH-Markt

neuroflash bietet Digital Twins, die speziell auf den DACH-Markt kalibriert sind. Unsere Plattform ermöglicht Concept-Tests, Claim-Tests und Zielgruppen-Befragungen in unter drei Stunden vom Briefing zum Report. Insights-Teams aus FMCG, Finanzdienstleistung und Pharma nutzen die Lösung, um ihre Kapazität zu vervielfachen, ohne Headcount aufzubauen. Wer den Kostenaspekt im Detail verstehen will, findet weiterführende Zahlen im Kostenvergleich Synthetic vs Traditional Pre-Testing. Methodische Grundlagen zur Validität liefert der Beitrag zu Digital Twins in der Marktforschung.

Mit neuroflash schneller zu validen Insights

neuroflash liefert KI-gestützte Marktforschung mit synthetischen Zielgruppen und Digital Twins für den deutschsprachigen Markt. Insights in Stunden statt Wochen, kalibriert auf realen Befragungs- und Verhaltensdaten und nahtlos integriert in Brand-, Copy- und Performance-Workflows. Jetzt kostenlos testen und in der nächsten Sprint-Woche die ersten Persona-getriebenen Insights gewinnen.

FAQ

Wie schnell ist eine Digital-Twins-Studie wirklich?

In der Praxis liegen Concept-Tests und Claim-Tests bei drei bis acht Stunden vom Briefing bis zum fertigen Report. Komplexere Studien mit mehreren Wellen oder Zielgruppen brauchen ein bis drei Tage. Klassische Vergleichsstudien dauern sechs bis zwölf Wochen.

Lohnt sich der Zeitgewinn auch für kleine Teams?

Gerade kleine Insights-Teams profitieren überproportional, weil sie sich keine externen Studien für jede Frage leisten können. Mit Digital Twins werden auch ad-hoc-Fragen beantwortbar, die früher gar nicht erforscht wurden.

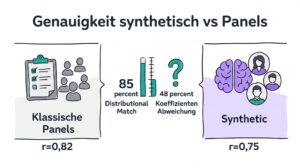

Sind die Ergebnisse so verlässlich wie klassische Studien?

Bei validierten Twin-Modellen für etablierte Zielgruppen liegt die Korrelation zu klassischen Befragungen typischerweise zwischen 0,85 und 0,95. Für Iteration und Screening ist das mehr als ausreichend, finale Validierungen kombinieren oft beide Methoden.

Wie integriert man die Geschwindigkeit in bestehende Prozesse?

Empfehlenswert ist ein Pilotprojekt mit zwei bis drei Studien-Typen, parallele Verprobung gegen klassische Methoden, Aufbau interner Standards und schrittweise Ausweitung. Die meisten Teams brauchen ein Quartal für die Umstellung.

Fazit

Fazit: Die Zeitersparnis bei Studien mit Digital Twins ist keine Marginalie, sondern ein struktureller Bruch mit dem klassischen Marktforschungsmodell. Wenn aus zwölf Wochen drei Tage werden, verändert sich nicht nur die Effizienz, sondern die Rolle der Insights-Funktion im Unternehmen. Marktforschung wird vom Bottleneck zum Beschleuniger, von der Hausaufgabe zum strategischen Sparringspartner, von der Validierung am Ende zur Iteration während des Prozesses. Wer 2026 noch klassisch arbeitet, konkurriert mit Teams, die zehnmal mehr Geschäftsfragen pro Quartal beantworten können. Der Wettbewerbsvorteil heißt nicht mehr bessere Daten, sondern schnellere Daten in besserer Qualität, und genau dafür sind Digital Twins gebaut.

Quellenverzeichnis

[1] Quirk’s (2025): „State of Insights Report 2025.“ https://www.quirks.com/articles/state-of-the-insights-industry

[2] ESOMAR (2024): „Global Market Research Report 2024.“ https://esomar.org/market-research-reports

[3] GreenBook (2025): „GRIT Business and Innovation Report.“ https://www.greenbook.org/grit

[4] Forrester (2025): „The State of Synthetic Research.“ https://www.forrester.com/report/the-state-of-synthetic-research

[5] McKinsey (2024): „How AI is Transforming Consumer Insights.“ https://www.mckinsey.com/capabilities/growth-marketing-and-sales/our-insights

[6] Kantar (2025): „AI in Market Research: Speed vs Depth.“ https://www.kantar.com/inspiration/research-services

[7] Gartner (2025): „Market Guide for AI-Augmented Consumer Research.“ https://www.gartner.com/en/marketing/research

[8] Bain and Company (2024): „Generative AI in Marketing and Insights.“ https://www.bain.com/insights/topics/generative-ai

[9] BCG (2025): „Speed as a Strategic Advantage in Consumer Goods.“ https://www.bcg.com/capabilities/marketing-sales/consumer-insights

[10] Nielsen (2024): „The Future of Concept Testing.“ https://www.nielsen.com/insights

[11] Insights Association (2025): „Industry Benchmarks for Research Turnaround Times.“ https://www.insightsassociation.org/research

[12] Deloitte (2024): „AI-Driven Market Intelligence.“ https://www2.deloitte.com/global/en/insights.html