Ein Multi-LLM Chatbot kombiniert mehrere Large Language Models (LLMs) wie beispielsweise GPT, Claude oder Gemini in einer orchestrierten Architektur. Statt jede Anfrage an ein einziges Modell zu schicken, entscheidet ein Router dynamisch, welches Modell am besten geeignet ist – basierend auf Kosten, Komplexität, Sprache oder Fachdomäne.

Multi-LLM-Chatbots können nahezu alles abdecken und sind vielseitig einsetzbar, da sie für fast alle KI-Aufgaben genutzt werden können. Die generierten Antworten (antwort) variieren je nach gewähltem Modell, was die Qualität der Ergebnisse beeinflusst, da der Router stets das beste Modell auswählt. Die unterschiedlichen capabilities der einzelnen LLMs ermöglichen es, gezielt auf verschiedene Nutzeranfragen zu reagieren und so optimale Resultate zu erzielen.

Kurz gesagt:Ein Multi-LLM Chatbot erhöht Qualität und Resilienz – und kann laut AWS durch intelligentes Routing bis zu 30 % Kosten sparen. Der access zu verschiedenen LLMs, etwa über APIs wie OpenAI oder lokale Lösungen wie Ollama, erleichtert die Interaktion und Integration in bestehende Systeme.

Doch: Die Architektur ist komplexer, DSGVO-relevant und nicht für jedes Unternehmen sinnvoll. In diesem Guide bekommst du eine fundierte Entscheidungsgrundlage – inklusive Architektur-Patterns, KPI-Vergleich, Kostenbeispiel und DACH-Perspektive. Multi-LLM-Chatbots unterstützen den Arbeitsalltag durch Automatisierung und Effizienzsteigerung und helfen dabei, alltägliche Aufgaben schneller und zuverlässiger zu bewältigen.

Zusammenfassung

- Ein Multi-LLM Chatbot kombiniert mehrere Sprachmodelle (z. B. GPT, Claude, Gemini), um je nach Anfrage das leistungsfähigste oder kosteneffizienteste Modell einzusetzen.

- Durch intelligentes Routing lassen sich Kosten deutlich senken – laut AWS sind Einsparungen von bis zu 30 % möglich.

- Die Architektur besteht aus Router, Modell-Layer, RAG-Komponente und Monitoring, was höhere Qualität und Resilienz ermöglicht.

- Multi-LLM-Systeme erhöhen jedoch Komplexität, Latenz und DSGVO-Anforderungen, da mehrere Datenflüsse kontrolliert werden müssen.

- Multi-LLM-Chatbots können verschiedene Aufgaben (tasks) effizient erledigen, indem sie je nach Anforderung das passende Modell nutzen.

- Nutzer (users) interagieren über eine Textschnittstelle mit dem Chatbot und erhalten individuelle, kontextbezogene Antworten.

- Multi-LLM-Chatbots ermöglichen die Automatisierung und Optimierung von Unternehmensprozessen (prozesse), was die Effizienz und Wettbewerbsfähigkeit steigert.

- Durch die Auswahl des optimalen Modells werden hochwertige Ergebnisse (ergebnisse) erzielt, die Produktivität und Genauigkeit verbessern.

- Besonders sinnvoll ist Multi-LLM im Enterprise-Bereich mit hohem Anfragevolumen und unterschiedlichen Use Cases.

- Best Practices umfassen Hybrid-Routing, RAG-Integration, MLOps-Monitoring und klare Kostenmodellierung, bevor das System produktiv geht.

Was ist ein Multi-LLM Chatbot?

Quelle: neuroflash

Ein Multi-LLM Chatbot ist ein KI-System, das mehrere Sprachmodelle orchestriert und jede Anfrage per Routing-Logik an das optimal geeignete Modell weiterleitet, um Qualität, Kosten und Performance zu optimieren; dabei werden verschiedene KI-Sprachmodelle (ki sprachmodelle) in einer Plattform gebündelt.

Warum werden Multi-LLM Chatbots strategisch relevant?

Laut Bitkom (2024) setzen 20 % der deutschen Unternehmen bereits KI-Anwendungen ein – Tendenz steigend. Gleichzeitig steigen:

- Infrastrukturkosten

- Regulatorische Anforderungen (EU AI Act, DSGVO)

- Erwartung an Antwortqualität

AWS beschreibt die Multi-LLM-Strategie so:

„The multi-LLM approach enables organizations to effectively choose the right model for each task, optimize for cost, latency, or quality.“ (Quelle: AWS Multi-LLM Routing Guide)

Oft hängt die Wahl des optimalen Modells jedoch vom Einzelfall ab, da unterschiedliche Anwendungsfälle individuelle Anforderungen stellen. Manche Nutzer oder Unternehmen haben spezielle Anforderungen und bevorzugen daher verschiedene Modelle für bestimmte Aufgaben.

Das bedeutet: Unternehmen wollen keinen Einheits-Chatbot mehr, sondern spezialisierte Systeme mit Kostenkontrolle.

Wie funktioniert ein Multi-LLM Chatbot technisch?

Quelle: neuroflash

Eine typische Architektur besteht aus 4 Ebenen:

- Frontend/UI: Hier interagieren Nutzer:innen mit dem Chatbot, z.B. über eine Weboberfläche mit Streamlit.

- Orchestrierung/Framework: In dieser Schicht werden die verschiedenen LLMs angebunden und orchestriert. Ein zentrales Framework ist hier Langchain, dessen wichtigste Komponenten (key components langchain) darauf ausgelegt sind, die Integration von großen Sprachmodellen (LLMs) zu vereinfachen und die Entwicklung von Multi-LLM-Chatbots zu unterstützen. Langchain arbeitet dabei oft im Zusammenspiel mit Tools wie Streamlit, Ollama und der OpenAI API.

- Modell-Layer: Hier befinden sich die eigentlichen KI-Modelle, wie z.B. GPT-4, Llama 2 oder Mixtral. Die Größe (size) der eingesetzten Modelle ist ein entscheidender Faktor für die Leistung und Skalierbarkeit eines Multi-LLM-Chatbots.

- Datenquellen/Knowledge Base: Externe Datenbanken, Dokumente oder APIs, auf die die LLMs zugreifen, um kontextbezogene Antworten zu liefern.

1. Router-Layer (Entscheidungsinstanz)

Optionen:

- 🔀 Regelbasiertes Routing

- 🧠 LLM-Klassifizierer

- 🔎 Semantic Routing via Embeddings

- 🔄 Hybrid-Routing (Best Practice)

Cloud-Anbieter wie Amazon Bedrock bieten bereits „Intelligent Prompt Routing“ an.

2. Modell-Layer (Spezialisierung)

Beispiel-Setup im Enterprise:

| Use Case | Modell |

|---|---|

| FAQ & einfache Anfragen | Claude Haiku |

| Strategische Analyse | GPT-5 |

| Deutschsprachige Rechtstexte | Gemini |

| Technische Dokumentation | Mistral |

| Code-Generierung & Review (Coding) | ChatGPT |

| Kreative Unterstützung & Datenanalyse (Copilot-Funktion) | Copilot |

ChatGPT ist ein vielseitiges Sprachmodell, das nicht nur für Konversationen, sondern auch für Coding-Aufgaben wie Code-Generierung eingesetzt werden kann. Copilot dient als unterstützendes KI-Tool, das kreative und analytische Aufgaben erleichtert.

3. RAG-Schicht (Retrieval-Augmented Generation)

Projektübersicht: Ziel dieses Projekts ist die Integration von Retrieval-Augmented Generation (RAG) in einen Multi-LLM Chatbot, um die Leistungsfähigkeit und Flexibilität bei der Nutzung verschiedener KI-Modelle zu erhöhen.

Fast jeder professionelle Multi-LLM Chatbot integriert RAG. Plattformen wie Poe bieten dabei ein gutes Beispiel, da sie verschiedene KI-Modelle bündeln und eine benutzerfreundliche Umgebung für die Erstellung und Anpassung von Chatbots bereitstellen.

Frameworks wie LangChain ermöglichen:

- Multi-Agent-Pattern

- Tool-Integration

- Hybrid-Routing

4. Monitoring & MLOps

Empfohlene Tools:

- Vertex AI

- MLflow

- Elastic Stack

- DataDog

Du musst loggen:

- Modellwahl

- Latenz

- Kosten pro Anfrage

- Fehlerraten

- DSGVO-relevante Datenflüsse

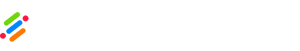

KI-Tools für die Chatbot-Entwicklung

Die Auswahl der richtigen KI-Tools ist ein zentraler Erfolgsfaktor für die Entwicklung moderner Chatbots, die auf Large Language Models (LLMs) basieren. Mit den passenden Tools lassen sich leistungsfähige, interaktive Text-Interfaces und Web Apps realisieren, die flexibel auf Nutzeranfragen reagieren und sich nahtlos in bestehende Unternehmensprozesse integrieren lassen.

Wichtige KI-Tools im Überblick:

- Langchain: Dieses Open-Source-Framework ist mittlerweile ein Standard in der KI-Chatbot-Entwicklung. Es vereinfacht die Integration verschiedener LLMs, ermöglicht komplexe Workflows und unterstützt Multi-Agent-Architekturen sowie die Anbindung externer Tools. Besonders für Multi-LLM Chatbots ist Langchain durch seine flexible Orchestrierung und die große Community ein echter Gamechanger.

- Streamlit: Mit Streamlit lassen sich in wenigen Minuten moderne Benutzeroberflächen für Chatbots und Datenanwendungen erstellen. Die Python-basierte Bibliothek ist ideal, um Prototypen oder produktive Web Apps mit Text-Interface zu bauen – ohne tiefgreifende Frontend-Kenntnisse.

- Ollama: Wer LLMs lokal und unabhängig von Cloud-Anbietern betreiben möchte, findet in Ollama eine schlanke Open-Source-Lösung. Damit können Unternehmen sensible Daten im eigenen Netzwerk halten und haben volle Kontrolle über die eingesetzten Modelle.

- OpenAI API: Für den Zugang zu den leistungsstärksten kommerziellen LLMs wie GPT-4 ist die OpenAI API die erste Wahl. Sie bietet eine stabile, skalierbare Schnittstelle und ermöglicht es, Chatbots mit modernster KI-Intelligenz auszustatten.

Durch die Kombination dieser Tools entsteht ein flexibler Tech-Stack, der die Entwicklung, Integration und Skalierung von KI-Chatbots auf Basis verschiedener Modelle und Frameworks ermöglicht. So können Unternehmen gezielt auf die Anforderungen ihrer Use Cases eingehen und die Stärken der jeweiligen Tools optimal nutzen.

LLM-API und Integration

Die LLM-API ist das Herzstück moderner Chatbot-Architekturen, denn sie stellt die Verbindung zwischen dem Chatbot und den zugrundeliegenden Large Language Models her. Über diese Schnittstelle können Chatbots Anfragen an verschiedene KI-Modelle senden und erhalten in Echtzeit intelligente Antworten – unabhängig davon, ob die Modelle in der Cloud oder lokal betrieben werden.

Zentrale Aspekte der LLM-API und Integration:

- Langchain OpenAI: Die Integration von Langchain mit der OpenAI API eröffnet Entwicklern die Möglichkeit, leistungsstarke LLMs wie GPT-4 direkt in ihre Chatbots einzubinden. Durch die flexible Schnittstelle von Langchain lassen sich zudem mehrere Modelle parallel ansteuern und gezielt für unterschiedliche Aufgaben nutzen.

- API Keys: Der Zugriff auf LLM-APIs erfolgt in der Regel über individuelle API Keys. Diese Schlüssel sind essenziell, um die Nutzung zu authentifizieren, den Zugriff zu steuern und die Sicherheit der Daten zu gewährleisten. Ein sorgfältiges Management der API Keys ist daher Pflicht in jedem professionellen Chatbot-Projekt.

- Datenschutz: Da bei der Nutzung von LLM-APIs oft sensible oder personenbezogene Daten verarbeitet werden, ist der Datenschutz ein zentrales Thema. Unternehmen müssen sicherstellen, dass alle Datenflüsse DSGVO-konform sind, insbesondere wenn externe Anbieter wie OpenAI eingebunden werden. Dazu gehören verschlüsselte Übertragungen, klare Datenlöschkonzepte und die Dokumentation aller Schnittstellen.

Die Integration von LLM-APIs ist somit weit mehr als ein technischer Schritt – sie ist ein strategischer Baustein für die Entwicklung sicherer, leistungsfähiger und skalierbarer KI-Chatbots. Wer hier auf bewährte Frameworks wie Langchain und etablierte Anbieter wie OpenAI setzt, schafft die Grundlage für innovative Lösungen, die sowohl den Anforderungen der Nutzer als auch den regulatorischen Vorgaben gerecht werden.

Multi-LLM vs. Single-LLM: KPI-Vergleich

| KPI | Multi-LLM Chatbot | Single-LLM |

|---|---|---|

| Kostenoptimierung | Hoch (Routing möglich) | Gering |

| Latenz | Höher (Routing-Overhead) | Niedriger |

| Qualität | Task-optimiert | Modellabhängig |

| Resilienz | Fallback möglich | Single Point of Failure |

| DSGVO-Komplexität | Höher | Niedriger |

| Entwicklungsaufwand | Hoch | Mittel |

Konkretes Kostenbeispiel (ROI-Betrachtung)

Quelle: neuroflash

Angenommen:

- 100.000 Anfragen / Monat

- 80 % einfache Queries

- 20 % komplexe Queries

Single-LLM (Premium-Modell):

100.000 × 0,02 € = 2.000 € / Monat

Multi-LLM:

- 80.000 × 0,005 € (kleines Modell)

- 20.000 × 0,02 € (großes Modell)

= 400 € + 400 € = 800 €

→ 60 % Ersparnis im Beispiel-Szenario

Natürlich kommen Infrastrukturkosten hinzu – aber das Potenzial ist signifikant.

Wann lohnt sich ein Multi-LLM Chatbot – und wann nicht?

Quelle: neuroflash

✅ Sinnvoll bei:

- Hohem Anfragevolumen

- Unterschiedlichen Use Cases

- Internationaler Ausrichtung

- Starkem Kostenfokus

❌ Nicht sinnvoll bei:

- Geringem Traffic

- Nur einem klar definierten Anwendungsfall

- Fehlender MLOps-Kompetenz

- Budget unter 50k € Implementierungskosten

DSGVO & EU AI Act: Was du beachten musst

Ein Multi-LLM Chatbot erhöht die Datenkomplexität.

Der European Data Protection Board betont:

„A model should be very unlikely to identify an individual or infer personal data.“

Du brauchst:

- Audit-Trails

- Verschlüsseltes Logging

- Regionale Datenresidenz

- Dokumentierte Risikoanalyse

Gerade im DACH-Raum ist das entscheidend.

Vendor Lock-in vermeiden

Wenn du Routing über Amazon Bedrock betreibst, bindest du dich an AWS.

Alternative:

- Kubernetes-Cluster

- Open-Source-Modelle

- Framework-basierte Orchestrierung (LangChain)

Strategische Frage:

Willst du Flexibilität oder Convenience?

Praxisbeispiel

Ein Maschinenbauunternehmen implementiert einen internen Multi-LLM Assistenten:

- HR → kleines Modell

- Technische Spezifikationen → GPT-4

- IT-Tickets → Spezialmodell

- Marketing → KI-Modul zur Erstellung und Analyse von Texten (texte)

- Designabteilung → Integration eines Moduls zur Verarbeitung und Generierung von Bildern (bild, image)

- Support → Automatische Transkription und Zusammenfassung von Videos (videos)

Ein exklusiver Mitgliederbereich präsentiert eine Story (story) als Fallstudie, wie der Multi-LLM-Chatbot die Zusammenarbeit zwischen Abteilungen verbessert und innovative Lösungen ermöglicht.

Ergebnis nach 6 Monaten:

- 22 % geringere Betriebskosten

- 35 % schnellere Bearbeitung einfacher Anfragen

- Höhere Zufriedenheit bei Fachabteilungen

So baust du einen Multi-LLM Chatbot in 6 Schritten

Quelle: neuroflash

- Use Cases segmentieren

- Query-Komplexität analysieren

- Routing-Strategie definieren

- RAG-Architektur integrieren

- Monitoring aufsetzen

- DSGVO-Dokumentation implementieren

Bereits bei der Planung sollte die Bedeutung der Chatbot-Entwicklung (chatbot development) berücksichtigt werden, insbesondere im Hinblick auf die Integration verschiedener Tools und Frameworks wie Langchain. Die Umsetzung empfiehlt sich als eigenständiges Projekt (project), um die Entwicklung, Implementierung und das Testen des Multi LLM Chatbots strukturiert und nachvollziehbar zu gestalten.

Häufige Fehler

⚠️ Kein Monitoring

⚠️ Keine Fallback-Strategie

⚠️ Routing ohne Testdaten

⚠️ Unterschätzter Wartungsaufwand

⚠️ Keine Kostenmodellierung vor Launch

Multi-LLM Chatbot direkt nutzen – ohne eigene Infrastruktur

Du willst die Vorteile eines Multi-LLM-Ansatzes nutzen, ohne selbst Routing, Hosting und Compliance aufzubauen? Bei neuroflash stehen dir GPT-5.2, Claude Sonnet 4.5, Claude Opus 4.5, Gemini Pro 2.5, Mistral Medium 3.1 und viele weitere Modelle in einer Plattform zur Verfügung. Du wählst pro Aufgabe das passende Modell – für Texte, Analysen oder kreative Projekte. Dazu kommen Brandvoice, Zielgruppensteuerung und DSGVO-konforme Sicherheit mit Servern in Deutschland. So profitierst du von Multi-LLM-Flexibilität, ohne den Infrastrukturaufwand.

FAQ: Multi-LLM Chatbot

Was ist der größte Vorteil?

Kosten- und Qualitätsoptimierung durch Modell-Spezialisierung.

Wie hoch ist der Implementierungsaufwand?

Je nach Architektur zwischen 3 und 6 Monaten.

Ist Multi-LLM sicher?

Ja – bei korrekter DSGVO-Umsetzung.

Ist Multi-LLM die Zukunft?

Im Enterprise-Bereich sehr wahrscheinlich, im KMU-Bereich selektiv.

Fazit: Multi-LLM Chatbot als strategische Infrastruktur

Ein Multi-LLM Chatbot ist kein Trend-Experiment mehr – sondern eine strategische Entscheidung.

Er lohnt sich, wenn du:

- Hohe Anfragevolumina hast

- Unterschiedliche Qualitätsanforderungen bedienen musst

- Kosten systematisch optimieren willst

Aber: Ohne MLOps, Monitoring und klare Datenschutzstrategie riskierst du Chaos statt Effizienz.

Mein Standpunkt:

Multi-LLM wird sich im Enterprise-Bereich durchsetzen. Für KMU bleibt es eine gezielte Option – kein Standard.

Quellenverzeichnis

- AWS – Multi-LLM Routing Strategies for Generative AI Applications

https://aws.amazon.com/blogs/machine-learning/multi-llm-routing-strategies-for-generative-ai-applications-on-aws/ - Bitkom – Erstmals beschäftigt sich mehr als die Hälfte der Unternehmen mit KI

https://www.bitkom.org/Presse/Presseinformation/Erstmals-beschaeftigt-Haelfte-Unternehmen-KI - European Data Protection Board (EDPB) – Opinion on AI Models & GDPR

https://www.edpb.europa.eu/news/news/2024/edpb-opinion-ai-models-gdpr-principles-support-responsible-ai_en - LangChain – Multi-Agent Documentation

https://docs.langchain.com/oss/python/langchain/multi-agent - DataCamp – Claude vs. Gemini Vergleich

https://www.datacamp.com/de/blog/claude-vs-gemini - Quantenfrosch – KI-Agent erstellen: Tool-Stack & Architektur (DACH-Perspektive)

https://quantenfrosch.at/blog/ki-agent-erstellen-tool-stack-architektur-fehler/ - ZDF – KI-Agenten & Google Gemini im Handel

https://www.zdfheute.de/wirtschaft/kuenstliche-intelligenz-google-gemini-shopping-agenten-online-handel-100.html